La duda como ventaja competitiva

Sobre el human-in-the-loop

En mi enésimo capítulo sobre el vibe coding (lo de hacer programas sin picar código), pasa que últimamente acepto todos los cambios que me propone la IA. Cuando empecé leía todas sus propuestas con detalle pero he llegado a un punto en que sí, que acepto, que ok a todo. Sin revisarlos ni rechistar.

¿Por qué? Pues porque no soy programadora y sé entre poco y nada de este mundillo. “La máquina sabrá”.

–Señora, ¿y entonces cómo te atreves a danzar por el pensamiento crítico?

Te dices en silencio mientras me juzgas (cuidado que yo también te estoy escuchando).

¿No te gustan mis valores? Espera, que tengo otros:

Soy contradictoria, y a mucha honra.

Heme aquí, a fustigarme delante de ti porque, oh, he pecado de complacencia algorítmica. Pero antes de que me lances la primera piedra, déjame que te cuente por qué este “pecado” tiene dos caras.

CARA A: Por qué NO soy negligente

Aceptar todo sin mirar suena a pereza intelectual pero, en realidad, una manera sensata de delegar es gestionar el riesgo. Una buena práctica sería aplicar la regla del semáforo a la hora de dejar a la IA que tome decisiones por nosotros:

🔴 ROJO (siempre decide el humano): datos personales, contratos legales, diagnósticos de salud o cualquier decisión que afecte directamente a la vida o la dignidad de las personas. Aquí la IA no debería tocar ni un punto sin que un profesional lo diseccione al cien por cien. No basta con que la IA te avise, el sistema debe tener “nodos de decisión” bloqueantes (Gatekeeping). El código no debería permitirme avanzar, publicar o enviar nada en semáforo rojo o ámbar sin una firma digital o una validación humana explícita.

🟡 ÁMBAR (Humano + IA): Comunicación pública, materiales creativos, prototipos que incluyen cifras o argumentos complejos. Aquí la IA propone, pero es el humano quien debería refinar, verificar y dar el tono final. Hay supervisión activa porque hay reputación en juego.

🟢 VERDE (IA con supervisión ligera): Borradores internos, lluvia de ideas para títulos, maquetación de notas o, como en mi caso actual, vibe coding. Si el código de mi programa falla no se cae el servidor de la NASA, sólo se rompe mi pequeño experimento. El riesgo es bajo, la confianza puede ser alta.

Este es mi principal argumento en esta cara A, que mi aceptación ciega no es negligencia, es un cambio de rol. He dejado de ser la artesana que revisa cada detalle para ser la productora musical. Un productor no corrige cómo el batería agarra las baquetas (el código), sólo juzga si el ritmo funciona para la canción (el vibe). Mi validación ya no es sintáctica (¿está bien escrito el código?), sino estética y funcional (¿hace lo que yo quería que hiciera?). Por tanto, si el vibe es correcto, la técnica es irrelevante para el objetivo final.

CARA B: Por qué SÍ soy negligente

Volvemos al rojo, a ese human in the loop que sí o sí tiene que estar al final del proceso para validar. El problema no es que la IA se equivoque y yo no me dé cuenta, sino que la máquina sea “suficientemente buena” el 99% de las veces y mi cerebro desconecte por falta de fricción.

Se llama sesgo de automatización a esa tendencia casi magnética a confiar más en la pantalla que en tu propio juicio. Es lo que ocurre cuando el GPS te dice que gires a la derecha hacia un campo de girasoles y tú vas directa a por las pipas en la cara.

Ya lo advertían Parasuraman y Riley1 en los noventa, cuanto más fiable es el sistema, menos supervisamos. En entornos profesionales, este vaciado de criterio ya está aquí:

Abogados que revisan por encima porque “el modelo suele clavar la jurisprudencia”.

Médicos que dudan menos si el sistema sugiere un diagnóstico probable.

Redactores que aceptan el tono de la máquina porque “es suficiente”.

¿Y en recursos humanos? La verdadera negligencia es externalizar la empatía. Si la respuesta sobre quién debe ascender siempre está en los datos, ¿quién sostiene la pregunta sobre el potencial humano? Ahí es donde el semáforo podría desmoronarse y entonces nos quedamos igual que estábamos. ¿O no?

Para evitar este “abandono de la supervisión” que comentaba con la abogada Mercedes de Santiago en este hilo de Substack, necesitamos sistemas que combatan activamente nuestra complacencia. Una forma sería mediante la trazabilidad del error. No me des la solución mascada, adjúntame la fuente exacta o el razonamiento lógico. Muéstrame un registro de “antes vs. después” destacando los cambios. Porque si me obligas a comparar, me obligas a pensar.

Incluso podríamos ir más allá e implementar alertas por desvío de confianza. Imagina un sistema que, de vez en cuando, me lance un test aleatorio. Que me pida validar una tarea sencilla para comprobar si estoy despierta. Si respondo con un “aceptar todo” sistemático, el sistema emite una alerta de fatiga. Me protege de mi propia pereza.

Además, todo esto debe entrar por los ojos, el diseño tiene que ser político.

Al igual que en las restauraciones de monumentos históricos, donde la piedra nueva se elige de un material o un tono distinto para que el espectador sepa exactamente dónde termina la ruina original y dónde empieza la reparación, nuestro software debe evitar el “falso histórico” cognitivo. Las sugerencias de la IA deberían usar colores diferentes a los del usuario, debería haber una jerarquía visual que nos diga dónde termina la máquina y dónde empieza el humano... si acaso eso es posible.

Y es que, cuando la línea se vuelve tan borrosa que el diseño interno no basta para darnos paz mental, empezamos a buscar desesperadamente “denominaciones de origen” externas. Queremos que alguien, desde fuera, nos certifique que todavía queda un rastro de alma bajo tanto algoritmo.

La complaciencia como nuevo riesgo

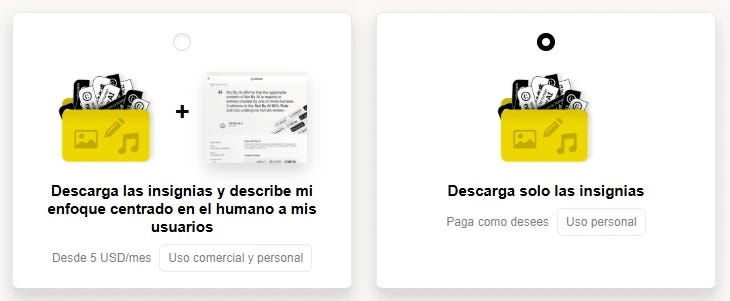

Es en este vacío de confianza donde han surgido marcas con certificaciones que funcionan como estándares para distinguir el contenido creado por humanos del generado por IA. Uno muy conocido es Not By AI. Para usar este sello, el creador debe garantizar que al menos el 90% del contenido ha sido generado por humanos. ¿Y cómo se aseguran ellos que eso sea del todo cierto? Pues no lo hacen, confían en el usuario. Vaya incongruencia.

Y lo que parecía una buena iniciativa... se terminó de desvanecer en este popup:

Cuidado, porque muchas certificaciones sólo garantizan marketing.

Ponerle una pegatina de ‘100% Humano’ a un producto mediocre no lo salva. Estamos cayendo en la trampa de valorar la procedencia (biológica) sobre la pertinencia (que se haga con mirada crítica y ética).

La única certificación válida

Si la máquina me devuelve algo que confirma lo que ya pensaba, ¿lo acepto porque es correcto o porque me tranquiliza? El hecho de que estés leyendo esto y te estés cuestionando tus propios procesos es la prueba de que sigues al volante. Sólo un humano se preocuparía por no estar siendo suficientemente humano.

Cómo funciona este texto (meta-análisis)

Ahora la deconstrucción de mis propios trucos:

Efecto Pratfall y honestidad: Confesar que no sé de código me hace vulnerable pero real, admito mi limitación antes de que tú la encuentres.

Reencuadre (framing): He pasado de llamarme “vaga” a llamarme “Productora Musical”. He cambiado el marco de referencia para que veas la delegación como una estrategia de alta dirección y no como pereza.

El falso dilema (Cara A vs Cara B): Te presento dos versiones opuestas para obligarte a navegar por la zona gris. No te doy la solución, te doy el conflicto para que tú también sientas la contradicción.

Gracias por leer. Si has llegado hasta aquí sin que una máquina te lo resuma, ya vas por delante del algoritmo.

P.D. Como me dijo la bibliotecaria mientras colgaba la cartela para mi expo de fotos dentro de una biblioteca, “uf, qué montón de texto, la gente es que no lee”.

Parasuraman, R., & Riley, V. (1997). Humans and automation: Use, misuse, disuse, abuse. Human Factors, 39(2), 230–253. https://doi.org/10.1518/001872097778543886

Seguimos leyendo pero cada vez tenemos menos paciencia para el relleno y lo que no nos interesa.

De ejemplo este texto de casi 30.000 palabras que escribí y muchísima gente me ha dicho que le ha encantado (aluciné que tantos se lo acabaran): https://www.sumapositiva.com/p/260-diez-ideas-de-buenos-libros-que